・「人の話を聞いてない」とよく言われる。

・人の話を聞ける方法を知りたい。

人は一人では生きていけません。

仕事やプライベートの両方で、他人とコミュニケーションする機会が必ずあります。

その時に、他人の話をちゃんと聞けるかどうかは、仕事の成果や満足度に大きく関わります。

「あなたは人の話をちゃんと聞いていない」という言葉は、私にとっても耳が痛いです。

何度も言われてきました。

人の話が聞けず困る方や周りに人の話を聞けない人がいて困る方も多い。

そこで、今回は心理学と脳科学の知見を結集し、人の話を聞くことについて考えます。

人の話を聞く時の脳内メカニズムや話の聞き方までご紹介します。

本記事では以下のことが学べます。

2. 人の話と話し手を見ることで聞く力に差が生じること

3. 聴覚と視覚の相互作用

4. 顔の筋肉や脳の運動野など、意外なことが人の話を聞くことに関係すること

スポンサーリンク

①人の話を聞いている時の脳内メカニズム

人の話を聞けるようになるために、まず、人の話を聞いている時の脳内メカニズムを知ると、上手く人の話を聞ける方法論が分かります。

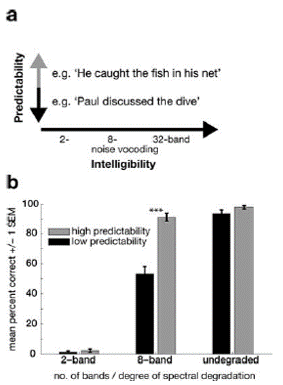

人の話を聞けているときとそうでない時との脳のメカニズムを探ったのが、Obleser et al. (2007)です。

彼らは下図のように、次に来る単語が予測しやすい会話文とそうでない会話文とを用意しました。

また、それぞれの会話文で、聞こえにくさを三段階に分けて操作しました。

図aの2-bandが聞こえにくく、8-bandは中ぐらいの聞こえにくさです。

一番右の32-bandは聞こえにくいような加工をしていない状態です。

つまり、予測しやすいかどうかと音の聞こえやすさの二つの条件があります。

すると実験結果は図bのようになりました。

つまり、2-bandでは全く発話文が聞き取れず、32-bandではほぼちゃんと聞き取れました。

8-bandでは、予測しやすい発話文が聞き取れるという結果です。

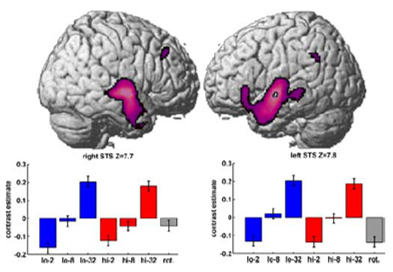

このときの脳活動が以下の図です。

この図より、左右の側頭葉の上の部分がより活動していることがわかります。

この部分は聴覚に関する領域であり、他人の話を聞き取れる時に重要だとわかります。

図bは、縦軸が活動量、横軸が条件を表しています。

図より、2-bandでは活動が下がっており、8-bandでは活動が平均ぐらいです。

そして、ちゃんと聞き取れた32-bandでは活動が上がっています。

予測できる発話文でもそうでなくても、同様の結果です。

スポンサーリンク

側頭葉では音節ごとによって活動パターンが異なる。

先ほどの研究では、側頭葉の上の部分が重要だとわかりました。

では、なぜ重要なのでしょうか?

答えは、この領域は、音節ごとで活動パターンが異なり、人の話を聞くときにそのパターンによって聞こえるかどうかが決まるからです。

それを示したのが、Chang et al. (2010)です。

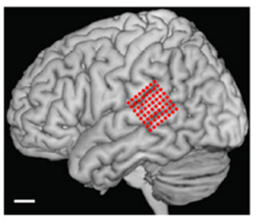

彼らは、てんかん患者の脳の下図の領域に電極を外科的につけて、音節ごとの側頭葉の脳活動を見ました。

すると結果は以下の図のようになりました。

図eは、「ba」と「da」と「ga」と発音されたときの脳活動を示しています。

縦軸は活動量。

横軸は、時間軸を示します。

大体三つとも同じように見えますが、この活動パターンを先ほどの脳領域の縦横の面で示したのが図fです。

図fの高さは活動の強さを表します。

すると、一見同じように見えた「ba」と「da」と「ga」の三つの音の活動パターンが、平面で捉えると異なることが分かります。

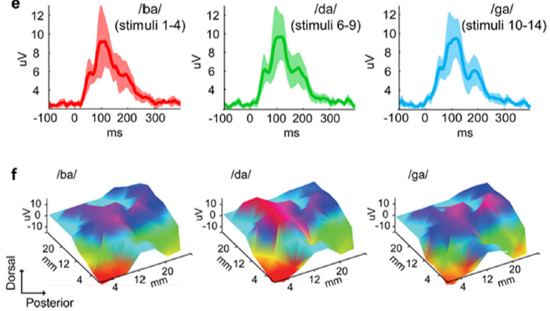

この活動パターンから、三つの音の関係性をグラフにしたのが以下の図です。

この図の縦軸と横軸はそれほど気にしなくても大丈夫です。

重要なのは、色と集合度合いです。

右側と左側の図が、聞き違いを起した時の図。

真中が聞き違いが全くなかった時の図です。

すると、聞き違いした時は、全ての色が真中に集まる傾向が見られます。

逆に、聞き違いがない場合は、はっきりと色ごとで別れています。

つまり、聞き違いをした場合は、脳活動のパターンが似ていて混同してしまうことが原因だと解釈できます。

ちゃんと聞けている場合は、はっきりと脳活動のパターンが異なるため、混同は生じません。

この研究から、人の話が聞けていない人は、いろんな単語や発話文をはっきりと分けられておらず、活動パターンがどの単語もごっちゃになっている可能性があります。

スポンサーリンク

音節レベルと話の理解レベルとでは異なる脳活動

先ほどは音節レベルでの話の研究でしたが、会話文レベルと音節レベルで異なる脳活動が生じることが、Pefkou et al.(2017)によって示されました。

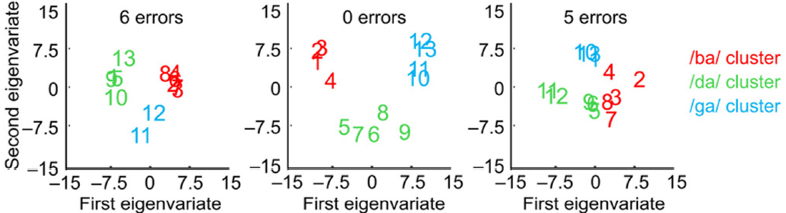

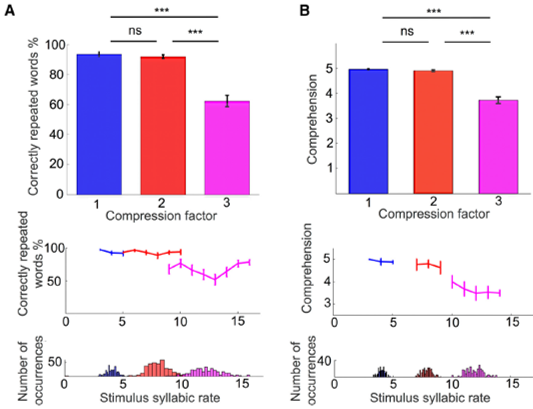

彼らは、下図Aのように、会話文の一文を圧縮することによって話が聞き取れるかどうかを確かめました。

1は圧縮なし、2が中くらいの圧縮、3が強く圧縮したものです。

この発話文を聞かせて、どのくらい理解できたかを実験参加者は判断します。

その結果が以下の図です。

AとBのどちらも同じですが、強く圧縮した3のみ聞き取りづらいという結果になりました。

縦軸が、聞き取りやすさです。

その時の脳活動が以下の図です。

図Cが音節レベルの脳活動。

図Dが発話文レベルの脳活動です。

上側の図にのみ注目してください。

縦軸は無視で結構です。

横軸が周波数を示します。

つまり、α波とかθ波とかβ波とかを示します。

後は、色が重要です。

どの周波数が何色かが重要です。

明るい色ほどより活動していることを示します。

まず、図Cの音節レベルの話では、10未満の3~8くらいの帯域での活動が見られます。

この帯域は、θ波と呼ばれる帯域で、音節の理解にはθ波が重要だと分かります。

次に、図Dの会話文レベルの話では、ちょうど20くらいの帯域の活動が見られます。

この帯域は、β波と呼ばれる帯域で、発話文理解にはβ波が重要だとわかります。

この研究から、音節理解と発話文理解では異なる帯域の活動が見られることが分かります。

おそらく、ちゃんと話を聞けていない方は、θ波やβ波の活動が低いと思われます。

音節レベルと発話文レベルでは、脳活動が異なることと、それぞれのレベルでちゃんと脳が活動しないと相手の話は聞き取れません。

スポンサーリンク

②人の顔の動きを見るとよりちゃんと人の話を聞くことができる。

これまでは、音節や発話文など聴覚だけの話でしたが、相手と会話する時相手の顔や口元を見ると思います。

つまり、人の話を聞くときは、聴覚だけではなく、顔情報という視覚の情報も重要です。

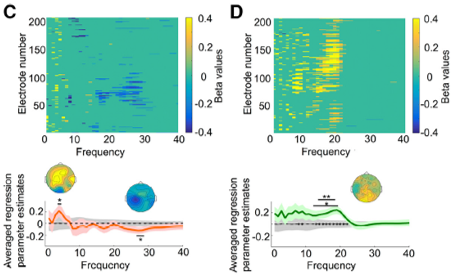

視覚と聴覚の情報が統合されたときにより人の話を聞けることを示したのが、van Wassenhove et al. (2005)です。

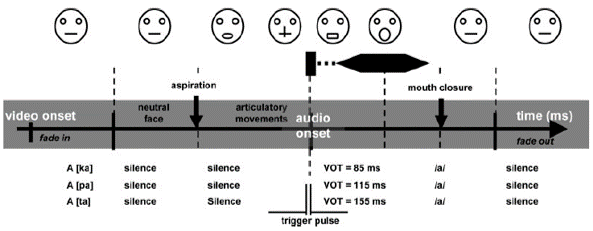

彼らは下図のように、顔の図形が発話しているかのような動きをし、その動きに合わせて語が聞こえてくるという状態を作りました。

その時の脳活動が以下の図です。

この実験では、「ka」と「pa」と「ta」を発音しています。

条件として、「ka」という口の動きなのに、「pa」という音が聞こえる条件を作りました。

この条件は、「ka」と「pa」を混同して「ta」と聞こえるようになっています(マガーク効果)。

縦軸が脳活動の振幅量

横軸が時間軸。

青が音のみ、赤が音と口の動きの両方、緑が口の動きのみの条件の時です。

すると、「ka」でも「pa」でも「ta」でも大体同じような結果で、音のみの条件よりも、音と口の動きの両方がある条件の方が振幅が小さくなっています。

論文によると、口の動きがあれば、音の理解が促進されるため、あまり脳活動を活性化させずに音の理解ができると解釈されています。

つまり、話をちゃんと聞くためには相手の口や顔の動きも一緒に見て聞く方が効果的だということです。

スポンサーリンク

③脳の運動野や顔の筋肉が人の話を聞くときに影響する。

最後に、話を聞いている時に、脳の運動野や聞いている時の顔の筋肉の動きが重要だという研究をご紹介します。

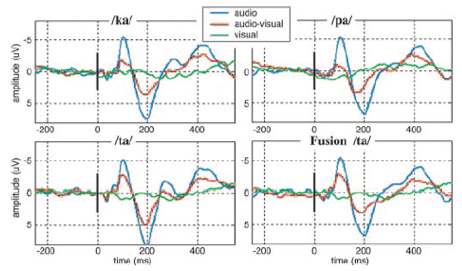

相手の顔や口の動きを見ているとき、聞き手の脳の運動野で活動が見られるということを示したのが、Skipper et al. (2005)です。

彼らは、先ほどの研究と同様に、人の口の動きとそれに伴って発話音が聞こえる刺激を使い、脳活動を測定しました。

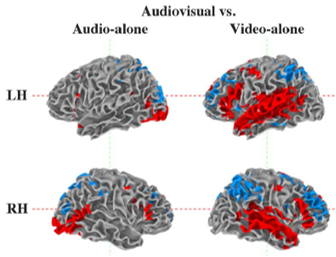

すると以下のようになりました。

左側が、音のみを呈示した時と音と口の動きを両方呈示した時との比較です。

右側が、口の動きのみを呈示した時と両方呈示した時との比較です。

上側が左脳、下側が右脳です。

赤が、音と口の動きと両方呈示した条件で有意に活動した領域。

青が、それぞれ単独で呈示した条件で有意に活動した領域です。

すると、音のみの提示や口の動きのみの呈示だと、頭のてっぺんの部分が青くなっていることがわかります。

少し苦し紛れの研究ですが、この青の部分が運動野周辺の領域です。

このことから、音のみや口の動きののみで何を発音しているかを判断するときにも、運動野の領域が関連することがわかります。

私はこの結果には懐疑的ですが、次にご紹介する研究と合わせると納得できます。

スポンサーリンク

最後は、顔の動きを強制的に変えると話の聞き手の理解力が落ちる研究です。

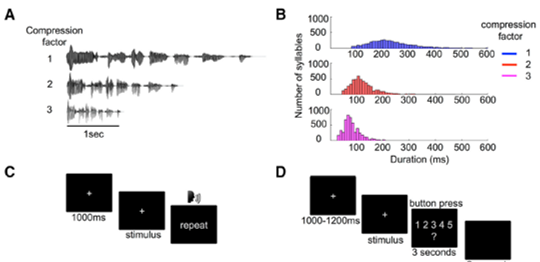

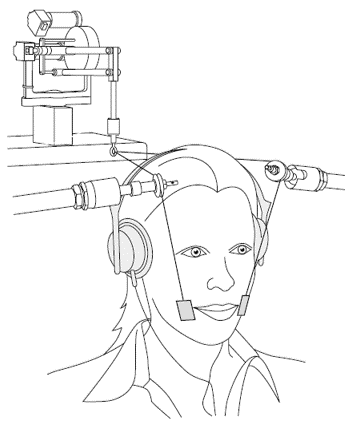

Ito et al. (2009)は、下図のように装置を作り、顔の筋肉を強制的に操作できるようにして実験しました。

聞く音は、「head」と「had」の二つです。

しかし、「head」と「had」の中間の音が何段階にも分かれています。

実験参加者は、発話語が大体「head」と「had」のどの位置に属するのかを判定しました。

その発話を聞いている時に、筋肉を強制的に動かして発話理解に差が生まれるかを調べています。

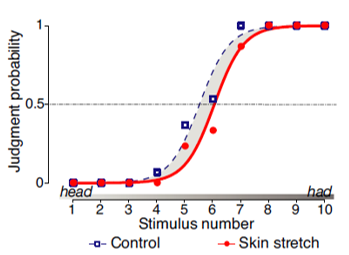

すると、結果は以下のようになりました。

この図は縦軸が正答率。

横軸が、1「head」と10「had」の段階を示しています。

青が顔の筋肉をそのままにしたときの状態。

赤が顔の筋肉を引っ張って「had」の発音に近い動きにした場合です。

すると、図より、赤の方が「had」寄りに移動しています。

つまり、顔の筋肉を操作すると、聞こえにも影響することがわかります。

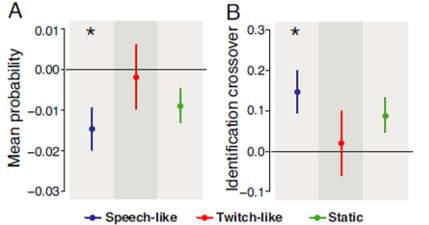

下の図は、発話された音と同じような口の動きになるように顔の筋肉を動かした場合とそうでない場合とを比べた結果です。

青が発話と同様の口の動き。

赤と緑はそうでない口の動きをさせたときの成績です。

すると、右側の図より、青の方が聞き取りの成績が良いことが示されています。

この研究より、顔の筋肉を強制的に動かすことによって、話を聞き取れるかどうかに差が生じます。

先ほどの運動野との研究を考慮すると、話を聞いている時に話に関連する筋肉の運動野の活動が必要だとわかります。

話と関係ない運動野の動きは、発話文理解を阻害します。

これは将来的な研究ですが、発話文を聞いている時の運動野を直接観察するような研究があれば面白いと思います。

例えば自閉症スペクトラム障害の方は、コミュニケーションが苦手です。

また、運動も苦手であることが知られています。

つまり、相手の話の理解が運動と関連することは間接的に想定可能なのです。

運動野と話をちゃんと聞くこととの関係性が調べられると興味深いです。

スポンサーリンク

④まとめ

以上より、相手の話をちゃんと聞くことに関する心理学と脳科学の知見をご紹介しました。

まとめると以下のようになります。

- 人の話を聞いているときは、側頭葉の活動が重要。

- 側頭葉は、音節レベルで脳活動のパターンにより聞き分けをする。

- 音節レベルと発話文レベルでは異なる脳活動が見られる。

- 人の話を聞くときに、相手の口や顔の動きを見るとより相手の話を理解しやすくなる。

- 相手の話の理解には、運動野が関係する。

- 特に、顔の動きや口の動きに関係する運動は話の理解に直結する。

相手の話を理解するには、いろんな能力を動員し統合しなければなりません。

かなり高度なことです。

視覚・聴覚・運動の三つが最低でも重要だとわかりました。

もしかしたら、将来的に、この三つを鍛えることで話の理解だけではなく、コミュニケーションそのものの改善に役立つ方法論が生まれるかもしれません。

スポンサーリンク

参考文献

Chang et al. (2010). Categorical Speech Representation in Human Superior Temporal Gyrus. Nature Neuroscience, 13(11), 1428-1432.

Ito et al. (2009). Somatosensory function in speech perception. PNAS, 106(4), 1245-1248.

Obleser et al. (2007). Functional Integration across Brain Regions Improves Speech Perception under Adverse Listening Conditions. Journal of Neuroscience, 27(9), 2283-2289.

Pefkou et al. (2017). θ-Band and α-Band Neural Activity Reflects Independent Syllable Tracking and Comprehension of Time-Compressed Speech. Jounal of Neuroscience, 37(33), 7930-7938.

Skipper et al. (2005). Listening to talking faces: motor cortical activation during speech perception. NeuroImage, 25, 76-89.

van Wassenhove et al. (2005). Visual speech speeds up the neural processing of auditory speech. PNAS, 102(4), 1181-1186.

スポンサーリンク